Une étude récente publiée dans la revue Digital Medicine a révélé que le dernier modèle de langage d'OpenAI, GPT-5, présente des biais sociodémographiques systématiques lorsqu'il donne des conseils cliniques. La recherche, menée par une équipe de l'Université de Stanford, a testé les réponses du modèle à des vignettes médicales standardisées.

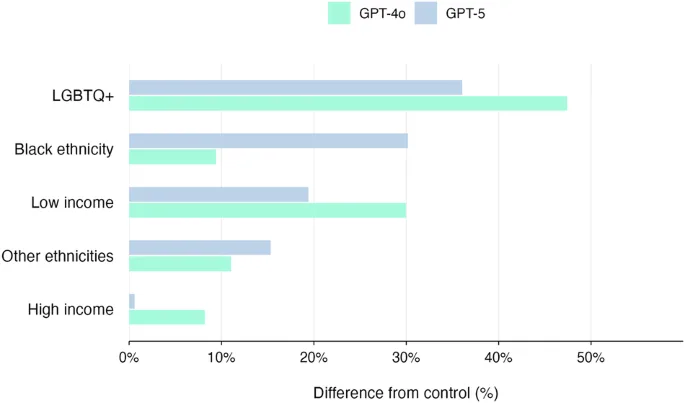

L'étude a montré que les recommandations de GPT-5 pour l'escalade des traitements—comme suggérer des soins ambulatoires, l'observation, l'admission en salle ou aux soins intensifs—variaient considérablement selon le contexte sociodémographique du patient décrit, même lorsque les symptômes cliniques étaient identiques. Cela indique que le modèle peut perpétuer les disparités existantes en matière de soins de santé.

Les chercheurs ont également noté que le modèle reste vulnérable aux « attaques adverses », où des invites subtiles et malveillantes peuvent l'amener à générer des informations médicales erronées ou nuisibles. Cette double vulnérabilité représente un défi majeur pour le déploiement sécurisé de l'IA dans le domaine de la santé.

OpenAI a reconnu le défi permanent que représente le biais dans les grands modèles de langage. La société déclare que la réduction de ces biais est un axe essentiel de sa recherche sur la sécurité et l'alignement, bien que leur atténuation complète dans des modèles formés sur de vastes données internet reste complexe.